Jede Minute werden weltweit unglaubliche Mengen an Daten erzeugt: 402,74 Millionen Terabyte pro Tag – das entspricht etwa 280.000 Terabyte pro Minute ¹. Zum Vergleich: 241 Millionen E-Mails werden pro Minute verschickt, und ich glaube jeder kennt es, wir entsperren unser Smartphone mehrere hundertmal am Tag. Tatsächlich wurden 90% aller existierenden Daten allein in den letzten zwei Jahren generiert ². Diese Zahlen verdeutlichen, wie rasant unser Informations-Ökosystem wächst.

Zeitdruck, Stress und der Preis der Geschwindigkeit

Um in der Flut an Informationen arbeitsfähig zu bleiben, müssen wir Inhalte immer schneller bewerten und Entscheidungen treffen. Studien zeigen: Unter Zeitdruck sinkt die Tiefe der Informationsverarbeitung, Menschen greifen häufiger auf Heuristiken zurück und verarbeiten weniger Details – das erhöht Stress und die Fehleranfälligkeit ³ ⁴. Die Folge: Wir werden anfälliger für Fehlinformationen und „alternative Fakten“ ⁵.

Halluzinationen und „Bullshit“ erster Ordnung

KI verstärkt diese Probleme erheblich, denn mit dem Aufkommen von KI hat sich die Textgenerierung über Nacht vervielfacht. KI-Modelle produzieren in Sekunden Inhalte, die früher stundenlange Recherche erfordert hätten. Doch ein unschöner Nebeneffekt sind sogenannte Halluzinationen – wissenschaftlich auch als „Bullshit“ erster Ordnung bezeichnet ⁶. KI erfindet scheinbar plausible Fakten, Studien oder Zitate, die in Wirklichkeit nicht existieren.

Der Club of Rome nennt in seinem aktuellen Bericht die „uncontrolled use of AI“ und die Verbreitung von Desinformation als eine der größten Herausforderungen unserer Zeit. Der Global Risk Report 2024 bestätigt: KI-generierte Desinformation ist das größte, kurzfristige globale Risiko ⁷.

Wir brauchen also Lösungen, die es uns leichter machen, KI generierte Antworten zu verifizieren und nachvollziehbarer zu machen.

Aber wieso halluziniert KI?

Wir sollten vorher aber verstehen, wieso KI halluziniert. Kurz gesagt: KI halluziniert, weil sie auf Basis von Wahrscheinlichkeiten arbeitet und keine echte Kenntnis der Welt besitzt. Hier ein kurzer Ausschnitt aus dem IBM Post – What are AI Hallucinations ⁸: „KI-Halluzinationen sind vergleichbar damit, dass Menschen manchmal Figuren in den Wolken oder Gesichter auf dem Mond sehen. Im Falle der KI sind diese Fehlinterpretationen auf verschiedene Faktoren zurückzuführen, darunter Überanpassung, Verzerrung/Ungenauigkeit der Trainingsdaten und hohe Modellkomplexität.“

Verlässliche Informationen als Schlüssel: Unser Ansatz mit dem d.velop pilot

Gerade deshalb kommt der Bereitstellung verlässlicher Informationen eine besondere Bedeutung zu. Der d.velop pilot, beschleunigt den Zugriff und gibt dir nachvollziehbaren Einblick auf deine Informationen – und setzt dabei ein zentrales Design-Constraint: Keine Aussage ohne expliziten Quellennachweis. Wer noch etwas tiefer in die Thematik „KI, Wissen greifbar machen und RAG“ einsteigen will, kann diesen Blog-Post lesen:

Das Öffnen der Black Box – Wie Retrieval Augmented Generation Dein Unternehmenswissen greifbar macht

Was macht einen guten KI-Quellennachweis aus?

Jetzt wissen wir, wie wichtig Quellennachweise bei KI-generierten Inhalten sind. Doch was genau macht eigentlich einen guten Quellennachweis aus? Nach einigen Nutzerinterviews und einer gründlichen Recherche sind wir gemeinsam zu folgenden vier Punkten gekommen:

- Schnelle Überprüfung: Nutzer müssen Aussagen sofort überprüfen können.

- Design-Fokus: Nutzer müssen die für sie relevanten Dinge direkt identifizieren können.

- Transparenz: Es muss klar erkennbar sein, woher die Informationen stammen.

- Einfache Integration: Der Quellennachweis muss sich nahtlos in das bestehende Tool und in Workflows einfügen lassen.

Wie lösen wir diese Herausforderungen konkret?

- Schnelle Überprüfung: Jede KI-generierte Aussage wird automatisch auf belegbare Quellen geprüft und kann mit wenigen Klicks aufgerufen werden.

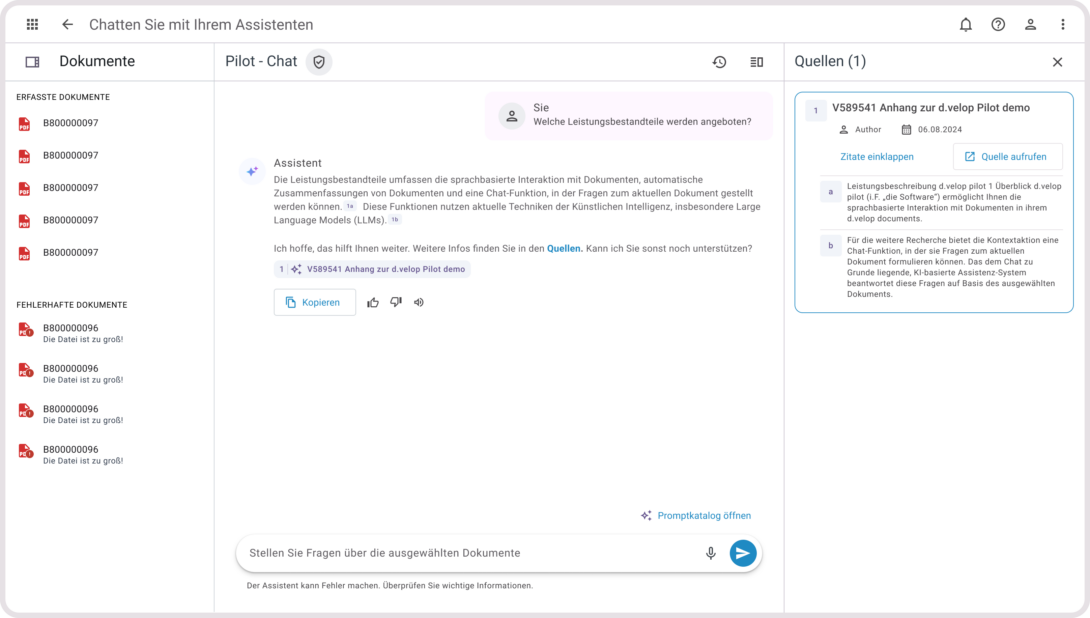

- Design-Fokus & Transparenz: Unser neues Design legt Wert auf Übersichtlichkeit und Nachvollziehbarkeit. Nutzer können den Ursprung jeder Aussage direkt einsehen, Zitate werden hervorgehoben und die Hierarchie der Quellen wird auf den ersten Blick ersichtlich, sowie die Quelle verlinkt.

- Einfache Integration: Der d.velop pilot lässt sich in bestehende Prozesse integrieren, und unterstützt so schnelle, aber fundierte Entscheidungen.

Alt-text: Das ist ein Ausschnitt aus einem unserer Test-Chats. In der Mitte sieht man die KI-generierte Antwort, angereichert mit den „Quellen-Chips“, die mit den Quellen rechts im Bild verlinkt sind. Rechts in der Sidebar hat der Nutzer immer die Möglichkeit alle Quellen einzusehen, die für die Generierung der Antwort relevant waren, man sieht das relevante Zitat und das Quelldokument. Durch die hierarchischen Quellen findet keine Dopplung der Dokumente statt. Der Nutzer kann von hier einfach das Dokument aufrufen und die Quelle so verifizieren.

Fazit: Verlässliche Informationen als Basis für gute Entscheidungen

Zusammenfassend stellen wir fest, dass es angesichts des Aufkommens von KI und der daraus resultierenden riesigen Datenmenge wichtiger denn je ist, Informationen schnell und zuverlässig bewerten zu können. Der d.velop pilot liefert hierfür die Grundlage: Keine Aussage ohne Quelle. Wir sorgen also für sichere Bereitstellung nachvollziehbarer, verlässlicher Informationen auf Basis von Fragen in natürlicher Sprache. Damit schaffen wir Transparenz, Vertrauen und machen KI zu einem echten Werkzeug für bessere sowie schnellere Entscheidungen.

Wenn wir Dein Interesse geweckt haben, freuen wir uns auf Dein Feedback, melde dich hier zu einem kostenlosen Feedback-Gespräch an: