Alle warten auf das nächste bessere Modell. Der eigentliche Wandel passiert aber woanders – und ist der entscheidende KI Trend 2026.

Der Fokus verschiebt sich: Sprachmodelle werden zur Commodity

Seit dem Erscheinen von ChatGPT im November 2022 sind große Sprachmodelle, die die Interaktion mit Chatbots wie ChatGPT erst ermöglichen, aus dem Alltag vieler Menschen nicht mehr wegzudenken. Und diese Modelle werden immer besser. GPT, Claude, Gemini, DeepSeek – der Wettbewerb ist groß, die Fortschritte sind beeindruckend. Aber die Frage, welches Modell gerade vorne liegt, ist für Unternehmen zunehmend zweitrangig. Modelle werden in 2026 mehr und mehr zur Commodity, wie Strom aus der Steckdose.

Warum das Modell selten das eigentliche Problem ist

Als AI Engineer erlebe ich das täglich: KI scheitert an scheinbar einfachen Aufgaben – und löst im nächsten Moment Probleme, bei denen ich selbst nicht erwartet hätte, dass es funktioniert. Was den Unterschied macht, ist selten das Modell allein. Es sind die Systeme, die drumherum gebaut werden. Und im Mittelpunkt dieser Systeme stehen 2026 zunehmend KI-Agenten – einer der prägendsten KI Trends im Unternehmenskontext.

Worum es in diesem Beitrag geht

Was ich in diesem Beitrag teile, ist meine persönliche Sicht auf das, was 2026 tatsächlich zählt:

- Warum KI-Agenten zur zentralen Architekturentscheidung werden,

- welche technischen und organisatorischen Fragen damit entstehen,

- warum Gedächtnis, Zugriffsrechte und Nachvollziehbarkeit wichtiger werden als Benchmarks

- und warum Entwickler ihre Arbeit neu erfinden, nicht verlieren

Der KI-Trend 2026: Agenten als Mittelpunkt moderner Systeme

Das Modell-Rennen verliert an Bedeutung

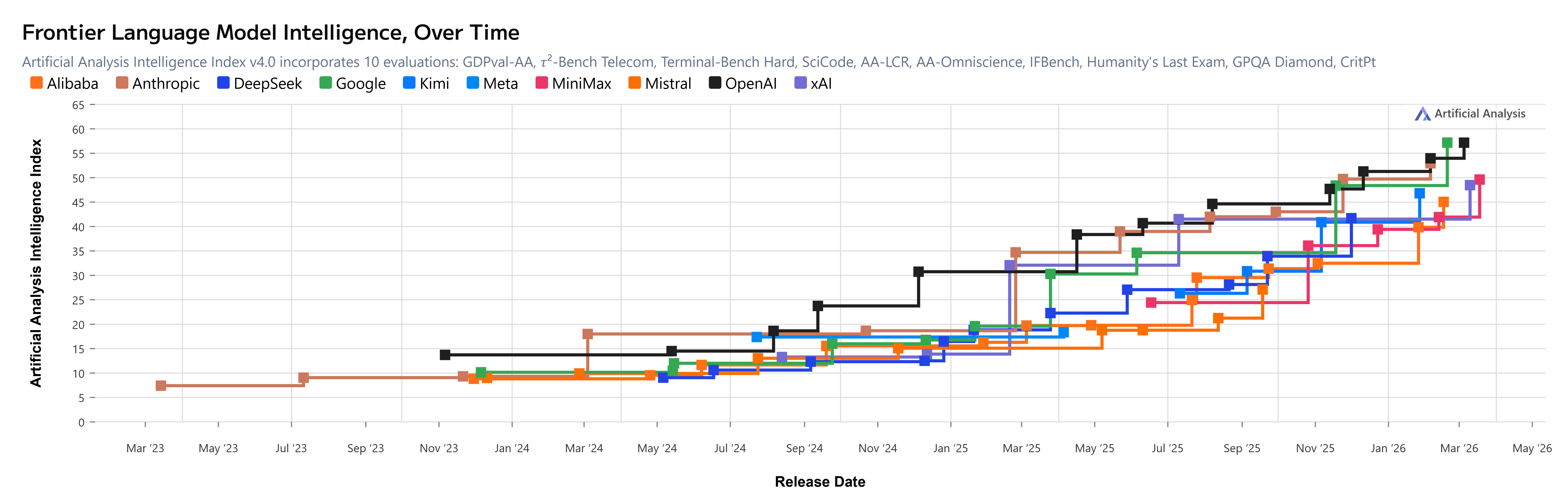

Die Frage, welches Modell gerade vorne liegt, ist schnell beantwortet – und morgen schon wieder überholt. Heute gibt es rund ein halbes Dutzend Organisationen, die konkurrenzfähige Frontier-Modelle liefern, allesamt mit weitgehend vergleichbaren Fähigkeiten. Alle paar Wochen überholen sie sich gegenseitig. GPT, Claude, Gemini, Llama: sie alle werden besser, aber keines von ihnen hat einen dauerhaften, strukturellen Vorteil.

Für Unternehmen ist das eine gute Nachricht: Sie müssen sich nicht mehr auf das Modell-Rennen konzentrieren. Sie können sich auf das konzentrieren, was wirklich zählt – nämlich darauf, wie Künstliche Intelligenz tatsächlich in die eigene Arbeit integriert wird.

Warum klassische Chatbots an ihre Grenzen stoßen

Und genau hier liegt das Problem klassischer Chatbots: Sie holen Nutzende nicht dort ab, wo ihre eigentliche Arbeit stattfindet. Wer täglich in einem DMS, ERP oder CRM arbeitet, wird einen separaten Chat-Tab nicht dauerhaft als primäres Werkzeug nutzen. Der Kontextwechsel kostet Aufmerksamkeit, manuelles Copy-Paste kostet Zeit, und am Ende bleibt der Chatbot ein nettes Zusatzwerkzeug, das selten tief in die Wertschöpfungsprozesse integriert ist und folglich selten den versprochenen Mehrwert liefert.

Die logische Konsequenz: KI-Agenten

Die logische Konsequenz sind KI-Agenten. Agenten sind Systeme, in denen ein Sprachmodell dynamisch seinen eigenen Prozess steuert und eigenständig Aktionen ausführen kann. Dort, wo wir früher die Lösung in Form eines deterministischen Workflows „fest verdrahten“ mussten, entwickelt der Agent heute dynamisch seine eigene Lösung. Dazu bewertet er seinen Fortschritt, reagiert auf Rückmeldungen aus seiner Umgebung und arbeitet iterativ auf ein Ziel hin – auch wenn der genaue Weg dorthin vorher nicht absehbar war und nicht deterministisch erfolgt.1

Ein praktisches Beispiel für KI-Agenten

Ein konkretes Beispiel: Nico Bäumer beschreibt in seinem Blog-Beitrag zu den IT-Trends 2026, wie ein Agent eine Rechnung gegen den Lieferschein prüft, eine Abweichung bemerkt und selbstständig eine Rückfrage formuliert.2 Was auf den ersten Blick nach klassischer Automatisierung klingt, ist in Wirklichkeit etwas anderes: Der Agent kontextualisiert Informationen, trifft eine Einschätzung und ergreift Initiative – innerhalb definierter Grenzen, nachvollziehbar und kontrollierbar. Genau das unterscheidet ihn von einem starren Workflow, der nur dann funktioniert, wenn alles so läuft wie vorhergesehen. Der Kern des Wandels, den wir im Moment sehen, sind Systeme, die dort handeln können, wo die Arbeit wirklich passiert.

Erfolg ist kein Zufall: 3 Dinge, die KI-Agenten wirklich brauchen.

Ein Agent ist nur so gut wie das, was er weiß – und was er tun kann. Beides klingt trivial. Beides wird erfahrungsgemäß in der Praxis aber regelmäßig unterschätzt.

1. Kontext: Das Gedächtnis des Agenten

Ein Sprachmodell hat von Natur aus kein Gedächtnis. Jede Anfrage startet bei null. Was den Unterschied zwischen einem nützlichen Agenten und einem Frustrierenden macht, ist deshalb oft nicht das Modell, sondern die Frage, welchen Kontext das System dem Agenten beibringt.

Guter Kontext bedeutet: Der Agent weiß, wer der Nutzer ist, wie er üblicherweise arbeitet, welche Entscheidungen in der Vergangenheit getroffen wurden, und was in der Organisation generell gilt. Ein Agent, dem man bei jeder Interaktion neu erklären muss, was mein Unternehmen macht und welche Regeln z.B. für Rechnungsfreigaben gelten, ist kein Agent.

Ein Agent ohne Gedächtnis ist wie ein Mitarbeitender, dem man bei jedem Meeting alles neu erklären muss.

Memory-Architekturen als Grundlage

Für gute Agenten-Systeme bedarf es also spezieller Memory-Architekturen:

- Ein Working Memory für die laufende Aufgabe,

- ein Short-Term Memory für den aktuellen Nutzerkontext,

- und ein Long-Term Memory für stabile Organisationsinformationen und Präferenzen.

Wer Agenten baut, muss sich früh die Frage stellen, was wo gespeichert wird – und wann es abgerufen wird.

Warum „einfach alles in den Prompt“ nicht funktioniert

Die aus Systemsicht scheinbar einfache Lösung – einfach alles, was das System über Nutzende, die Organisation und den Nutzungskontext weiß, in den Prompt packen – funktioniert aber nur bis zu einem gewissen Punkt. Neuere Modelle bekommen zwar immer größere Kontextfenster (bis zu 10 Mio. Tokens) und können damit in der Theorie immer mehr Informationen innerhalb von einer Anfrage verarbeiten. Systeme, die immer alles Wissen in den Kontext packen, anstatt den Kontext gezielt mit nur im Nutzerkontext relevanten Informationen zu füllen, erzeugen nicht nur hohe Kosten, sondern werden auch durch zwei technische Phänomene begrenzt:

- Lost-in-the-Middle: Modelle performen schlechter, wenn relevante Informationen in der Mitte eines langen Kontextfensters stehen.3

- Context Rot: Je länger ein Kontextfenster wird, desto mehr kann das Modell den Fokus verlieren.4 Diese Situation ist vergleichbar mit einem Menschen, der mehrere Aufgaben gleichzeitig bearbeitet – auch wenn viel gleichzeitig verarbeitet wird, führt eine fokussierte Herangehensweise oft zu effizienteren und besseren Ergebnissen.

Ein gut verwalteter, gezielt aufgebauter Kontext schlägt einen übervollen Prompt fast immer. Agentensysteme, die das ignorieren, werden in der Produktion scheitern.

2. Werkzeuge: Was der Agent tun kann

Kontext allein reicht jedoch nicht aus.

Ein KI Agent, der alles weiß, aber nichts tun kann, ist letztlich ein sehr teures Nachschlagewerk.

Was Agenten von Chatbots unterscheidet, ist ihre Handlungsfähigkeit. Und diese hängt stark davon ab, auf welche Werkzeuge Agenten Zugriff haben. Im einfachsten Fall sind das interne Funktionen: einen Datensatz abrufen, einen Status setzen, eine Datei lesen. Das reicht für viele Szenarien innerhalb eines bestehenden Systems. Aber je mehr Agenten echte Wertschöpfung übernehmen sollen, desto häufiger stößt man an Systemgrenzen – und der Agent müsste eigentlich auch nach außen greifen können.

MCP vs. klassische APIs

Genau hier kommt MCP (Model Context Protocol) ins Spiel, das Anthropic Ende 2024 vorgestellt hat, und das seitdem eine bemerkenswerte Eigendynamik entwickelt hat.5 Die Idee: ein standardisierter Weg, über den Agenten mit externen Systemen kommunizieren können, modellunabhängig und erweiterbar. Das Bild, das sich schnell eingebürgert hat:

MCP ist der USB-Anschluss für KI-Applikationen.

Allerdings mehren sich in der Entwickler-Community auch die kritischen Stimmen. Das Argument: Agenten kommen mit klassischen CLIs und APIs oft besser zurecht als mit MCP-Schnittstellen – weil sie genau dafür trainiert wurden. MCP dagegen führt eine zusätzliche Abstraktionsschicht ein, die nicht immer einen Mehrwert bringt und in der Praxis eigene Fehlerquellen mit sich bringt.6

Ob MCP sich als Standard durchsetzt oder klassische CLIs und APIs am Ende die pragmatischere Wahl bleiben, ist heute schlicht nicht vorherzusagen. Was aber unabhängig davon gilt: Agenten brauchen Zugriff auf Werkzeuge, um sinnvoll Arbeit zu erledigen. Wie diese Integration technisch aussieht, ist eine Frage der technischen Umsetzung.

3. Ein System, das mit seinen Modellen wächst

Was mich an gut gebauten Agentensystemen am meisten fasziniert, ist ein fast schon unfairer Vorteil: Sie werden automatisch besser.

Wenn ein System sauber entworfen ist, also der Kontext durchdacht ist, Werkzeuge vorhanden sind und die Grenzen der Autonomie sinnvoll gesetzt sind, dann profitiert es unmittelbar von jedem Modell-Update. Dinge, die heute noch nicht zuverlässig funktionieren, werden in einigen Monaten möglich sein, ohne dass sich am System selbst irgendetwas ändert. Das Modell darunter wird einfach besser.

Boris Cherny, einer der Köpfe hinter dem derzeit beliebtesten Coding-Agenten, Claude Code, bringt genau das auf eine schlichte Formel: „Bet on the more general model.“7 Wer auf allgemein gehaltene, flexible Systeme setzt, gewinnt mit jedem Modellsprung. Auf der anderen Seite laufen hochgradig spezialisierte Lösungen Gefahr, schnell zu veralten. Claude Code selbst ist dafür ein Beispiel: Was als simpler Terminal-Prototyp begann, ist heute für rund 4 % aller öffentlichen GitHub-Commits verantwortlich – nicht, weil das System ständig neu gebaut wurde, sondern weil die Modelle darunter besser wurden.

Das ist der strukturelle Unterschied zu klassischer Software:

Ein gutes Agentensystem ist kein fixes Produkt. Es ist eine Plattform, die mit der KI-Entwicklung mitwächst.

Jenseits der Technik: Was KI-Agenten wirklich verändern

Architektur, Kontext, Werkzeuge – das sind die technischen Grundlagen. Was Agenten für Unternehmen, für Arbeit und für die Gesellschaft bedeuten, ist eine andere Frage, die aber mindestens genauso drängend ist.

Was Agenten heute schon können

Ein Beispiel, das Anfang 2026 viral ging, ist OpenClaw.8 Der österreichische Entwickler Peter Steinberger hat innerhalb kürzester Zeit ein Open-Source-Agentensystem gebaut, das schnell 145.000 GitHub-Stars sammelte und einen regelrechten Hype auslöste. Openclaw ist ein Agent, der auf dem eigenen Rechner läuft und Zugriff auf alle eingeloggten Sessions, wie z.B. E-Mail, Kalender und Browser, hat. Der Agent lässt sich über Messaging-Apps wie WhatsApp oder Telegram steuern. Man schreibt: „Buch mir einen Flug von Frankfurt nach Berlin, Freitagmorgen“ – und er tut es. Die Aufgabe wird dabei nicht etwa über eine API-Integration mit definierten Workflows erledigt, sondern indem der Agent den Computer steuert, wie es sonst ein Mensch tun würde.

Der nächste Schritt: Einsatz im Unternehmen

Auch wenn Openclaw derzeit hauptsächlich auf Consumer-Ebene platziert ist, wird diese Dynamik auch im Unternehmenskontext immer stärkeren Einzug erhalten. Wir werden in den nächsten Monaten auch in Unternehmen zunehmend Agenten-Systeme sehen, die eigenständig Rechnungen prüfen, Genehmigungsprozesse anstoßen, Kundenkommunikation übernehmen oder Daten zwischen Systemen bewegen.

Nachvollziehbarkeit und Zugriffsrechte

Wenn ein Mensch eine Entscheidung trifft, kann man ihn fragen, warum. Wenn ein Prozess eine Entscheidung trifft, kann man den Code lesen. Doch wenn zukünftig Agenten immer mehr Entscheidungen treffen, sind diese oftmals nicht direkt nachvollziehbar.

Ein Gericht akzeptiert kein einfaches ‚Das hat die KI entschieden‘ als Begründung.

Agenten, die eigenständig handeln, erzeugen eine Nachvollziehbarkeitslücke. Agentensysteme werden diese Lücke in der Zukunft schließen müssen. Jederzeit muss klar sein, wer bestimmte Entscheidungen getroffen hat, auf welcher Grundlage und in welchem Kontext diese getroffen wurden.

Warum Protokollierung entscheidend wird

Systeme werden also zukünftig Entscheidungen entsprechend protokollieren müssen, damit menschliche Aufsicht und Rückverfolgbarkeit möglich sind. Unternehmen, die Agenten produktiv einsetzen wollen, müssen definieren, was ein Agent tun darf.

Zugriffsrechte als kritischer Faktor

Eng damit verbunden ist die Frage der Zugriffsrechte. Je mehr Zugriff ein Agent hat, desto nützlicher wird er. Umso größer ist auf der anderen Seite aber auch das Schadenspotenzial bei Fehlern, Manipulationen oder Missbrauch.

Welche gesellschaftlichen Fragen Agenten aufwerfen

Hinter dem technischen Fortschritt stehen zwei Fragen, die weit über Unternehmensgrenzen hinausgehen:

1. Wofür wollen wir KI einsetzen?

Dass die Frage „Wofür wollen wir KI einsetzen?“ längst keine akademische mehr ist, zeigen zwei aktuelle Beispiele.

- Das US-Verteidigungsministerium forderte jüngst Anthropic auf, seinen KI-Vertrag für autonome Waffensysteme und Massenüberwachung zu öffnen. CEO Dario Amodei lehnte ab – und Anthropic wurde infolgedessen prompt als „Supply Chain Risk“ eingestuft, ein Label, das bislang chinesischen Tech-Konzernen vorbehalten war.9

- Ein zweites Beispiel, das weniger offensichtlich wirkt, aber nicht weniger aufschlussreich ist: Amazon warb im Super Bowl mit einem Spot für eine neue KI-Funktion seiner Ring-Kameras namens „Search Party“.10 Die Story: Ein Hund läuft weg, die Nachbarschaft aktiviert ihre Ring-Kameras, die KI durchsucht alle Aufnahmen nach dem Tier – und der Hund findet den Weg nach Hause. Was Kritiker sofort bemerkten: Eine KI, die einen entlaufenen Hund über ein stadtweites Kameranetz verfolgen kann, kann dasselbe mit Menschen tun. Die Funktion war standardmäßig aktiviert. Der Aufschrei war groß genug, dass Amazon eine kurz zuvor geschlossene Partnerschaft mit dem Polizei-Überwachungsunternehmen Flock Safety wieder beendete – und einige Nutzer ihre Kameras schlicht abmontierten.

2. Wie verändert KI unsere Gesellschaft?

Die zweite Frage ist sogar noch schwerer zu beantworten. KI wird zunehmend immer stärkeren Einfluss auf wesentliche gesellschaftliche Bereiche haben. Das naheliegendste Thema in diesem Bereich ist vermutlich die Frage, wie KI-Agenten Arbeit verändern: Führende Experten gehen davon aus, dass ein erheblicher Teil der Büroarbeit, wie wir sie heute kennen, automatisiert werden könnte. Eine Studie, die unlängst im Harvard Business Review erschien, zeigt für die Gegenwart: KI reduziert Arbeit nicht – sie intensiviert sie.11

Die längerfristigen Auswirkungen auf den Arbeitsmarkt sind weniger klar. Analysten diskutieren Szenarien, in denen breite Automatisierungswellen nicht nur Jobs umschichten, sondern ganze Berufsfelder auflösen – und damit Kaufkraft und wirtschaftliche Stabilität in einer Weise gefährden, die klassische Instrumente der Wirtschaftspolitik kaum adressieren könnten.

Wie KI unsere Gesellschaft insgesamt verändert, ist heute nicht in Gänze abzusehen. Was Unternehmen jedoch in der eigenen Hand haben: wie und wofür sie KI einsetzen – und mit wem. Die Wahl des Anbieters ist eine Frage der Souveränität: die Möglichkeit, mit Partnern zusammenzuarbeiten, denen man vertraut und die eigene Werte teilen.

20. bis 24. April | Die d.velop AI Week: In einer Woche zu effizienten Dokumentenprozessen mit Agentic AI

Agenten im praktischen Einsatz: Entwickler:innen zwischen Automatisierung und Bedeutungswandel

Dass KI Arbeit verändert, haben wir im letzten Abschnitt gesehen. Als Entwickler erlebe ich diesen Wandel gerade besonders nah. Softwareentwicklung ist der Use-Case, in dem KI-Agenten schon heute stark in der Praxis angekommen sind.

Die Beispiele der letzten Monate sind schwer zu ignorieren. Ein einzelner Entwickler baut OpenClaw quasi im Alleingang.8 Spotifys Senior-Entwickler:innen haben laut dem Unternehmen seit Dezember keine einzige Zeile Code mehr selbst geschrieben.12 Beim Anthropic-Hackathon gewinnt ein Anwalt gegen über 500 Entwickler. Nicht, weil er besser coden kann, sondern weil Domänenexpertise in einer Welt, in der KI das Coding übernimmt, zunehmend entscheidet.13 Und in einem Experiment bei Anthropic selbst bauen 16 parallel laufende Claude-Instanzen innerhalb von zwei Wochen ohne einen einzigen menschlichen Entwickler einen vollständigen C-Compiler mit 100.000 Zeilen Code.14

Es drängt sich also die Frage auf, ob in Zukunft überhaupt noch Softwareentwickler:innen benötigt werden. Ein Blick in die Geschichte dämpft den Enthusiasmus. COBOL sollte 1959 so lesbar sein, dass Business Manager ihren eigenen Code schreiben könnten. Expertensysteme in den 1970ern sollten Programmierung automatisieren. 4GL-Tools in den 1980ern versprachen dasselbe. Zuletzt waren No-Code-Plattformen im Hype. Jede Generation brachte die Ankündigung mit, Entwickler:innen überflüssig zu machen, und jede scheiterte am selben Punkt.15 Denn das alleinige Schreiben von Code macht nur einen Teil der Arbeit aus. Entwickler:innen müssen Anforderungen verstehen, Architekturentscheidungen treffen, Systeme sicher und wartbar halten, mit Stakeholdern kommunizieren. Diese Tätigkeiten hat kein Werkzeug bisher ersetzt. Und es ist unwahrscheinlich, dass aktuelle KI-Systeme gerade das Problem lösen, an dem alle Vorgänger gescheitert sind.

Die neue Rolle von Entwickler:innen

Was sich ändert, ist nicht, ob Entwickler:innen gebraucht werden, sondern wofür. Die Grenze zwischen menschlicher Intention und lauffähiger Software verschiebt sich nach oben. Weniger Code schreiben, mehr definieren, was gebaut werden soll – und überprüfen, ob das, was gebaut wurde, das Richtige ist. Das ist kein Bedeutungsverlust. Es ist eine andere, anspruchsvolle Arbeit. Eine, die tieferes Domänenwissen, stärkere Kommunikationsfähigkeiten und ein klareres Verständnis von Systemanforderungen verlangt. Der Anwalt, der beim Hackathon gewinnt, ist vielleicht nicht die Ausnahme. Er könnte ein früher Hinweis darauf sein, wie Agenten die Zukunft von Softwareentwickler:innen verändern könnten.

Was bedeutet der Wandel von KI Chatbots zu KI Agenten für Unternehmen?

Im Titel dieses Beitrags haben wir die Frage aufgeworfen, was der Wandel von Chatbots zu Agenten für Unternehmen bedeutet. Die ehrliche Antwort: Er stellt Unternehmen vor eine Entscheidung, die sie nicht mehr aufschieben können.

Die eigentliche Frage ist nicht mehr, ob KI in Wertschöpfungsprozesse integriert werden soll, sondern wie dies geschieht.

Klassische Chatbots haben gezeigt, wo ihre Grenzen liegen. KI-Agenten sind der nächste logische Schritt – nicht als Technologie-Experiment, sondern als Weg, KI dort wirksam zu machen, wo Arbeit wirklich passiert.

Was gut gebaute Agentensysteme dabei auszeichnet: Unternehmen kaufen keine Lösung, die in einem Jahr veraltet ist. Sie kaufen eine Plattform, die mit der Zeit aktiv besser wird. Zum einen geschieht dies automatisch über neue, stärkere Modelle, auf denen Agentensysteme aufsetzen. Und zum anderen durch Memory-Architekturen, die das System mit jeder Interaktion ein Stück klüger machen. Das ist ein struktureller Vorteil, den klassische Software nicht bieten kann.

Gleichzeitig bringen Agenten neue organisatorische Anforderungen mit sich. Welche Zugriffsrechte hat ein Agent? Wo enden seine Befugnisse? Wer trägt Verantwortung, wenn er eigenständig handelt? Dies sind Fragen, die Unternehmen frühzeitig für sich selbst beantworten müssen.

Und schließlich gilt: Wer Agenten einsetzt, gibt ihnen Zugang zu sensiblen Daten, Prozessen und Entscheidungen. Die Wahl des Anbieters ist deshalb keine technische Nebenfrage. Sie ist eine Frage des Vertrauens – in Technologie, in Werte, in Verlässlichkeit.